JETROが出展支援する、世界最大のテクノロジー見本市「CES」に参加した注目企業に本誌編集長・杉原行里が訪問。独自のスキャナーとFMCW測定系を組み合わせることで、従来の LiDAR(ライダー)を超える次世代型のLiDARシステム開発に成功した株式会社SteraVision(ステラビジョン)。完全自動運転を実現可能にする独自技術について同社CEOの上塚尚登氏に話しを聞いた。

独自技術で新しい市場価値を創ることをめざす

産総研発のベンチャー企業

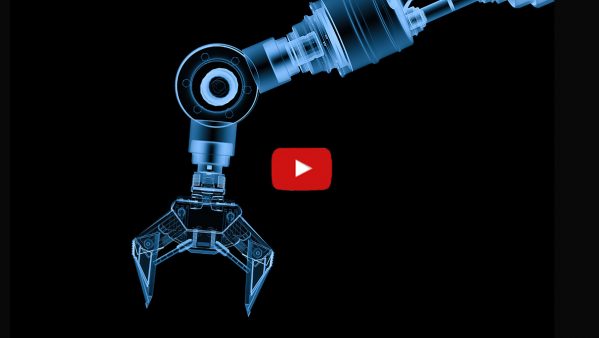

杉原:産総研発のベンチャー企業ということですが、具体的にどのようなことをしている会社なのでしょうか。

上塚:産総研(国立研究開発法人産業技術総合研究所)というのは、日本に3組織しかない特定国立研究開発法人の一つで、茨城県つくば市にあるつくば本部エリアにあるのですが私たちはその一部にある4部屋を借りて、研究・開発に取り組んでいます。本社は産総研の隣にあって、つくば市が運営するインキュベーション施設(株式会社つくば研究支援センター内つくば創業プラザ)のシェアオフィスを借りているんです。

左「HERO X」編集長・杉原と右SteraVision CEO・上塚氏

杉原:設立は最近ですか?

上塚:2016年12月です。産総研で培われた光通信技術を応用して、独自方式の光ビームステアリングデバイスと、FMCW方式の測定システムを組み合わせた次世代型LiDAR(Light Detection and Ranging:光による検知と測距)の開発と製造販売をやっています。製品としては、“Digital FMCW LiDAR”&光ビームステアリングデバイス “MultiPol™”があります。

車の中でお酒も飲めるし仕事もできる、

完全運転をめざす

上塚:Digital FMCW LiDAR”&光ビームステアリングデバイス “MultiPol™”は、独自に開発した、これまでにない新しい形のスキャナーです。これによって我々がめざすのは完全自動運転の実現です。

杉原:一般の車でも、最近はアクセルを離しても設定した速度のまま走り続けるクルージング機能や、車間距離を保ってくれる機能など、自動運転にかなり近づいていますが、ステラビジョンではそれをさらに進化したものにする技術を開発中だと伺いました。実際のところ、今、一般的な車両についているものは、まだ自動運転と言えるものではないですよね。

上塚:そうですね。ご指摘の通り、ドライブアシストと完全自動運転はかなり異なります。自動運転のレベルには0から5までがあり、レベル2まではドライブアシストです。ここでは事故が起きたときはドライバーが責任を持ちます。それに対して完全自動運転では、人が運転することはなく、車の中でお酒も飲めるし仕事もできるといった、新たな価値も生まれます。その一方で、事故が起ればシステムが全ての責任をもたなければなりません。

杉原:レベル4くらいを開発目標にしている、というのが世の中の潮流でしょうか。

上塚:そうですね。我々が目指すのは「完全」自動運転、つまりレベル5ということになります。実は自家用車の完全自動運転は伸び悩んでいて、どこが伸びているかというとトラックの完全自動運転です。コロナ禍で買い物へ行かなくなった代わりに、在宅で注文する機会が増え、輸送用トラックの出荷台数が凄い勢いで伸びている。そんな中で、トラックの完全自動運転、特に高速道路の完全自動運転のニーズが増加しています。ドライバーの身体的負担を減らすだけではなく、燃費も良くなります。ガソリンが高騰していることもあり、アメリカでは本当によく伸びているんですよ。

杉原:なるほど。そして、ズバリ、御社の製品の強みはどのあたりになるのでしょうか?

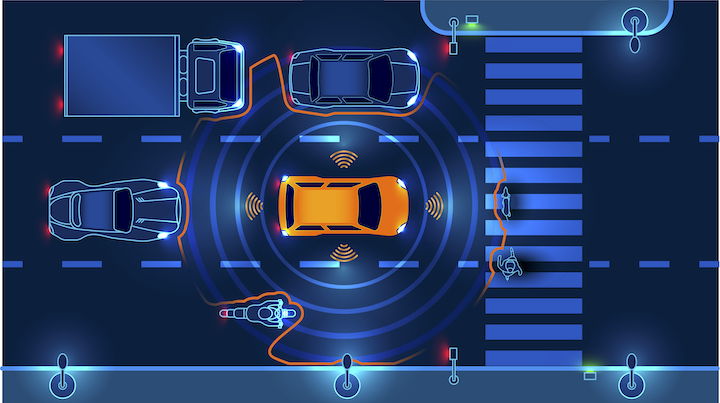

上塚:我々のLiDARは、大きくふたつの技術を持っておりまして、ひとつがスキャナーです。LiDARというのは、光の方向を見ながら戻ってきた光で、距離と速度も求めることができるというシステムです。その距離と速度を求めるために、我々は光の波の性質を利用する『FMCW(Frequency Modulated Continuous Wave radar:周波数変調連続波レーダー』という方式を採用しています。これを利用して「完全自動運転」に必要な“目”を作ろうというのが我々の目標です 。

距離を測るLiDARの方式としてはToF(Time Of Flight:光の飛行時間)というのが主流なので、LiDARのスタートアップは、アメリカを中心に世界で百数十社がある中で、ほとんどがToFを採用しています。これは光の粒の性質を利用して光を外に出して、戻ってきた光の粒をカウントするという方式で、光が戻る時間から距離や速度を求めるやり方です。光は1秒間に地球を7周半するのですが、実は我々から見ると光の速度は非常に遅い。というのも、戻ってくるのにだいたい1マイクロ秒かかるからです。つまり、300メートルくらい先へ行くのに1マイクロ秒も必要ということです。往復で2マイクロ秒かかる。エレクトロニクスで言うと2マイクロ秒は遅いんです。ですから、我々は別の方法を考えたのです。

また、ToFは太陽や対向車からの光の影響を非常に受けやすいという問題もあります。そのため、ToFは「ドライブアシスト」のために用いることはできるのですが、我々が目指す更に高いレベルの「完全自動運転」には向かない。

杉原:それで、新技術を開発しているということですね。

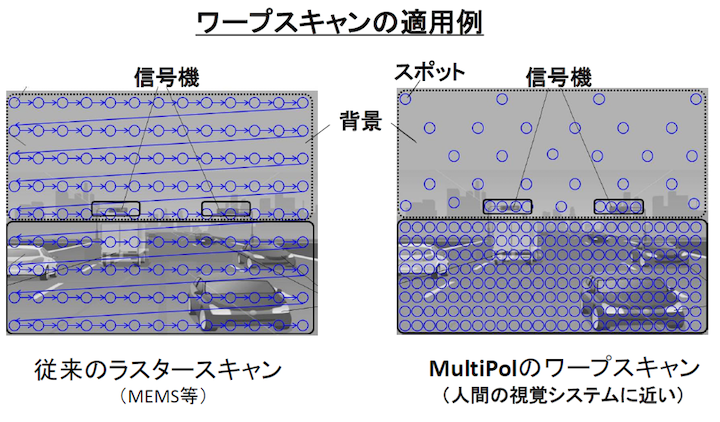

上塚:はい。産総研で培われた光通信技術を応用して、光ビームによる FMCW方式の測定系を開発しました。これにより、見たいところ(必要なところ)を好きなだけ詳しく“見る”(ワープスキャン)ができるようになりました。

ワープスキャンを使うと運転に必要な情報だけを見られるようになる。

杉原:2016年に上塚さんとCTOの所武彦さんで創業されたということですが、2人は元々ライダーやセンサーに関する研究をされていたんですか?

上塚:我々のヒストリーは、実は光通信部隊なんです。私は光通信のデバイスなどの分野をやっていて、2019年に入社した所は光トランシーバー関係の開発をしていました。実はFMCWというのは光通信のデジタルコヒーレント通信とほとんど同じなんです。だからそのまま進んでいたら、非常にうまくいったんです。

杉原:なるほど。そこから、ToFのほうが世界的な潮流として使われていたけどもFMCW が来るだろうと踏んだということですよね。重複するかもしれませんが、従来のLiDARとの大きな違いはどのあたりになるのでしょうか。

上塚:我々はLiDAR単独ではなく、カメラと組み合わせることで、たとえば運転中の、物体が右から左へ、前から後ろにくるという動きに合わせて、必要なところを詳しくスキャンできます。ここが我々の優位性です。

カメラは全体を見るのは優れていますが、無駄な情報を省き、いかに効率化するか、つまり「見たいところだけ見る」というのが我々の会社のスローガンです。運転中に必要なのは、運転に必要な情報だけです。空とか地面とか見ても仕方がない。無駄な情報もすべて処理すると、コンピュータパワーも使いますし、エネルギー的にも無駄が多いんです。

杉原:車にスーパーコンピュータを積むわけにいきませんからね。これはすごいですね、面白いですね。

上塚:対象が人なのか猫なのか、ボールなのかは、ディープラーニングで物体認識もできます。たとえば人とか車とか、衝突の危険性があるものはまずカメラで認識します。そうすると、その右側にあるステラビジョンのLiDARで実際の距離を測り、情報を色で表します。距離により色分けをして、赤だと遠い、青だと近い、緑が中間ぐらい。そして、それが「車」か「人」だとなったら、そこまでの距離により衝突する可能性があるかどうかを判断、危ない場合はブレーキをかける。運転に必要最低限の情報さえ取り込めれば、これだけのことができます。データ処理を極限まで減らし、重要な物は見落とさない独自の技術があるため、車だけでなく、健康医療分野への応用にも期待がかかっているところです。

杉原:僭越ながら、僕がとても刺さったのは、データの重さが全く変わるところです。軽くなるから情報を処理するスピードも上がるわけですよね。

上塚:それです! まさにその通りです! 要は自動運転といっても、ある程度車のスピードを上げられなければ意味がない。車が速く動けば、それだけ早く情報が上がってこないと、事故につながりかねない。そうなるとやはり情報は高速でほしいわけです。ただし、それを全画面の全距離を無限で測るとしたら、それはスーパーコンピュータの処理が必要です。このようにデータ処理を極限まで減らし、ただし重要な物は見落とさないというのが重要なのです。

杉原:素晴らしいです。僕らの目にも欲しいですね。

上塚:人間の目はそもそもそういうことをやっているんです。景色を見ているけど見てるのは自分の関心があるところだけだし、目に入った情報のすべてを脳は処理していませんよね。

杉原:そのとおりですね。

上塚:それを、実際のコンピュータやLiDAR、光学センサーを使って実現しましょうというのが我々のコンセプトである「見たいところを見る」ということです。

杉原:今回はCESにも出展されていますが、反響はありましたか?

上塚:はい。今引き合いがいっぱいあって、独自性を非常に高く評価してくださる方が多いですね。アメリカから来た方や、駐在の方も来られましたので話をして、海外の方からも是非取り入れたいと言っていただきました。

杉原:自動運転のレベル4レベル5の話もそうですし、健康データだったり、様々なものも含めて世の中を大きく変えていける可能性を感じます。

上塚:そうですね。実際に、健康関係のところからも引き合いはあります。

杉原:個人的にも大変興味深いお話でした。ぜひ御社へ足を運んで、実際に技術を拝見させてください! 今日はありがとうございました。

上塚尚登 (うえつか・ひさと)

1981年東京工業大学を卒業。 専門領域は光デバイス技術。 日立電線(現 日立金属)に入社し,光通信デバイスビジネスを立上げた。 社内ベンチャーのヘッドとして約100億までの部門に成長させた経験を持つ。

関連記事を読む