目次

あらゆる情報がデータ化され、これまで見えづらかった事象が可視化されるようになった現在。エンタテイメントやスポーツ分野におけるデジタルテクノロジーの可能性について語り合った前編に続き、後編ではさらに突っ込んだデジタルアート、さらには金融や医療分野についても話が及んだ。まだ混沌としているブロックチェーン技術や、倫理の問題が立ちはだかる身体データの活用など、今を生きる我々が避けては通れないトピックスについてのヒントがここにある。いずれにせよ、しばらく真鍋氏の動向から目が離せないことだけは確実だ。

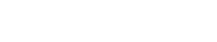

東京現代美術館にて展示された

《Rhizomatiks × ELEVENPLAY “multiplex”》2021

《Rhizomatiks × ELEVENPLAY “multiplex”》2021 「ライゾマティクス_マルティプレックス」展示風景(東京都現代美術館、2021年) photo by Muryo Homma(Rhizomatiks)

杉原:さて、今東京都現代美術館で開催している「rhizomatiks_multiplex」についてお伺いしたいです。僕はまだ動画でしか拝見していないのですが、実際に見た人の感想を訊くと、みんな口を揃えてすごい!って絶賛していますよ。

真鍋:お客さんにわざわざ足を運んでいただくだけの価値がある体験にしようというコンセプトがありました。生で、肉眼で見てもらって、リアルなオブジェクトを動かすことや空間を上手く使うことなどを感じてもらいたかったんです。

杉原:白いオブジェクトが動くのは、ルンバとかで使われているSLAM(自己位置推定と環境地図作成の同時実行)ですか?

真鍋:《Rhizomatiks × ELEVENPLAY “multiplex”》では、外からセンサーカメラを使ってオブジェクトについているマーカーを認識して位置と角度をトラッキングしています。外で動いているロボットはGPS、RTK-GNSSですね。映像だけでなくかなりたくさんのアナログ装置を用いています。残念ながら4月は丸々緊急事態宣言でクローズしていました。

杉原:もったいない! せっかくの機会だからもっと延期してくれればいいのに。コロナで気分が落ち込んでしまいがちですが、こういう時期こそアートやスポーツの力で、個々の価値観を再定義できたらいいと思っているのです。

NFTの抱える問題と可能性について

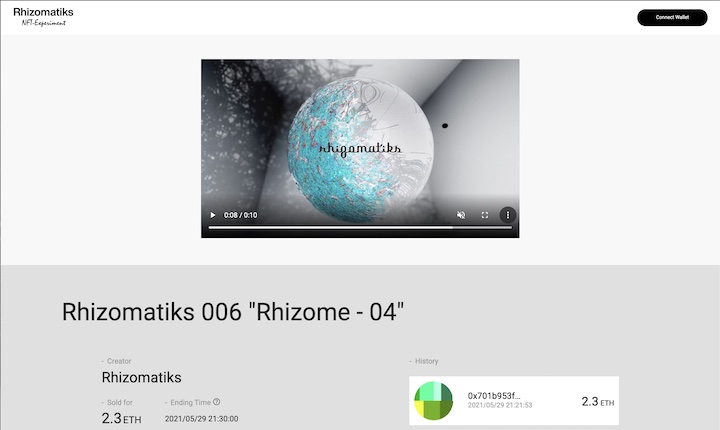

杉原:そうした中で、NFT(ブロックチェーン技術を使って固有の価値を持たせる)が昨年から急激に注目されるようになりましたね。知人が「真鍋さんの作品を買ったぞー」という話をしていて、びっくりしていたんですよ。

真鍋:今はほとんどのクリエーターが既存のマーケットプレイス、OpenSea、Rarible、Foundationなどで作品をミントしていると思うのですが、ライゾマは独自のマーケットを作りました。実践を通じて現状分析、未来予測を行うという意味合いが大きいですね。

杉原:ライゾマのNFTを使ったマーケット知らなかったです! とはいえ、この種のマーケットはまだきちんとしたプラットフォームになってないですよね。どちらかと言えばアイデア先行で始まって、まだアーリーアダプター向けなんですよね。

真鍋:6年前にドイツのカールスルーエ・アート・アンド・メディア・センターではビットコインのトランザクションのビジュアリゼーションや自動取引をテーマにした作品を展示したこともあり、ブロックチェーン関連は興味がある分野だったのでNFTも早くから注目していました。

杉原:この間、レブロン・ジェームズのダンクシュートの動画が2000万円で売られたことも話題になりましたね。

真鍋:NBAトップショットですね。いやぁ、海外の動きは早いですね。まだ黎明期で何が本命かは判断が難しいところもあるのですが、そこを含めて面白いと思っています。

杉原:ちょうどiTunesで楽曲を購入できるようになった頃、WinnyとかNapsterとか(ファイル共有サービス)が出てきて、問題になった時と似ていますよね。ある程度の不正には目を瞑りながらもサービス自体を普及させていくという。結局大事なことは、アーティストの権利をどう守るのかということですよね。

真鍋:NFTには可能性があることは揺るぎない事実かと思います。特に永続性の部分は大きいのではないでしょうか。例えば、YouTubeの画像はYouTubeのサービスが終わってしまったら無くなってしまいますよね。しかしNFTアートでよく使われているIPFSというハイパーメディア分散プロトコルを使えば、対改ざん性、耐障害性、対検閲性など作品が存在する上でのメリットがあります。もちろん、画像や動画、3DデータなどだけではなくDNAデータをアップロードするなど、貴重なデータを保存することにも使えますし、ゲームから始まってアートに移行して、これからはさらに広い分野でこの技術が使われるだろうなと思います。

杉原:遊休資産が一気に値上がりするパターンがありますよね。例えば、昔作ったプロモーションビデオの一部の切り取りを買える訳じゃないですか?

真鍋:眠っていたコンテンツがNFTをきっかけに蘇って価値が出てくるということもあるでしょうね。よく言われていることではありますが、音楽の流通やミュージックビデオも形態が変わっていくんじゃないかなと思います。日本ではまだまだ事例が少ないですよね。海外だとWarp Recordsの代表的なアーティストであるAphex Twinがオーディオビジュアル作品を出していたり、有名どころでも面白い事例もたくさんあります。

杉原:たしかBLURもやっていますよね。僕個人としては、今後さらにNFTを利用したサービスが支持されると思うし、自分自身でもライゾマの作品を購入したいと思っています。ただ気がかりなのがめちゃめちゃ薄型でかっこいいスクリーンというか、デジタルアート作品にぴったり合うモニターがあればいいなと。やっぱり自分が惚れ込んだ絵画作品には、それ相応の額装が必要になるじゃないですか? ライゾマの作品はライゾマのディスプレイとセットにして鑑賞したいですものね。

真鍋:まさにおっしゃる通り! 先読みされた感じがしました。作品を買った人がどうやって鑑賞するのかというと、結局ディスプレイが必要になります。ですから、僕らはウォレット搭載のNFTディスプレイの開発も検討しています。

先端医療におけるデータ活用とこれから

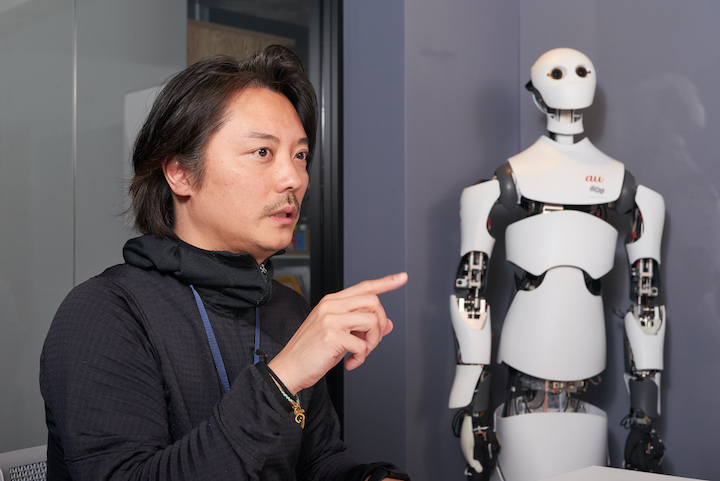

杉原:今回お話をして、ライゾマとRDSに親和性があるなと思ったことが、身体の可視化についてです。単純にデータを医療につなげようとしているのではなく、新しい項目を見つけて、今僕らが生活している中での当たり前をもう少し面白くできないだろうかと考えているのです。歩くという単純な行動が、ドラゴンクエストウォークとかポケモンGOとか、コンテンツが付与されるだけでエンタテイメントになる。そうした背景とかコンテキストみたいなのをぶち込んでいきたいなと考えているのです。そこで大事なことは、コミュニケーションでありUXなんですよね。僕らはあくまでもテクノロジーの基礎とツールを提供しているだけで、出口をどうするかが課題なんです。例えば、医療データを解析して「あなたの身体はこんな状態です」とぶっきらぼうに言われるような、しょっぱいUXだったら「そんなの要らない!」ってなっちゃうと思うから。

真鍋:たしかに、いきなりエクセルのグラフを見せつけられても興醒めしてしまいますよね。そもそもセンシティブな情報ですし、そんなこと知りたくないという人も多いですから。

杉原:真鍋さんの作品を見ていると、奥深いところにあるメッセージのように見えて、実はすでに身近にあったことを可視化してくれているのではと思ったのです。健康状態をダイレクトに伝えるだけではなく、どういう風に生活を改善した方がいいとか、コーチングから始めたらいいのかなと。だから、真鍋さんが取り組んでいるテクノロジーとアートを掛け合わせる手法を使って、1つのアライアンスになればいいなと。点と点が面になっていくように医療データを掛け合わせて、人々のQOL(クオリティ・オブ・ライフ)につなげていきたいのです。

真鍋:人の脳に埋め込んだ方がQOLが上がるというレベルまで行けるかどうか、いう話ですよね。個人的には早くやってみたいんです。この間も京都大学に行ってMRIのデータを取らせてもらって作品を制作したり、特任教授をやっているSFCでは藤井先生の協力を得てTMSと呼ばれる電気刺激を用いた作品制作を行っています。普段は主に医療に使われるものですね。

杉原:わっ! 痛そうですね。頭蓋骨も通り抜けて、脳に通電させているのですね。

真鍋:モーキャプのシステムとMRIのデータをTMSのシステムと組み合わせています。ちょっと痛いです(笑)。視覚野を刺激してどのような映像体験が出来るかを調べました。その時は思うような結果は得られなかったのですが、今後は作品の体験や制作に繋がればと思っています。

杉原:先ほども話しましたが、イーロン・マスクがやっていることにも通じますよね。デバイスを装着して脳に電流を流すことで、手を動かすことなくテレビゲームのキャラクターを動かすことができるという。

真鍋:それから最近面白かったのが、ドルビーの人たちと一緒にスタンフォード大学の研究所に1週間滞在して行った実験です。最近のテレビゲームはHDRが進化して、眩しいくらいに高解像度かつ高階調度になっています。それを利用してゲーム中の爆発シーンを見ると、本当に火災が起きたと思って顔の表面温度が上がる。脳波のデータはノイズが多くて使いづらいのですが、サーモのデータは使いやすいんです。

杉原:高所の映像を見ただけで手に汗をかく現象と同じですね。脳に刺激を与えることで、実際に火を使わずに火傷をさせることもできると聞きました。僕のプロジェクトでもサーモを利用した歩行実験で、その人の身体状態が大体わかるんですよね。

真鍋:僕は昔骨折したところがあって、ちゃんと治療せずにいたので歩き方がおかしくなっていると思うので、是非杉原さんのところで実験してもらいです。

今後のデジタルアートはさらなる変革期に突入

杉原:それでは最後に、コロナ以降のデジタルアートの展望について、どんな風に予想しているのかを教えてください。

真鍋:コロナの反動でリアルスペースに対する欲求が高まっている。それは来年の秋ぐらいまでには必ず戻ってくるでしょうね。

杉原:たしかにそうでしょうね。僕はデジタルに対してそれほど好意的ではなかった人たちが、コロナを通じて一気にデジタルにシフトしてきたと実感しています。

真鍋:本当にものすごく変わりましたし、実際アート界も変わってきています。現代アートの人たちはVRとかに懐疑的でしたが、そういう人たちですらオンラインギャラリーやバーチャルギャラリー、NFTを普通に使うようになってきた。もはやデジタル、リモート、オンラインは現代の必需品ですね。あっという間に人々が合意して価値観が変わった。

杉原:多くの人たちにとっては大変な時期だけれども、既にその前から取り組んでいた人たちからしたら、半歩先かなと思っていた未来が、もうここまで来たという感じですよね。

真鍋:もうここまで来て、あっという間にその先に行こうとしているというか(笑)。例えばミュージシャンがグリーンバックでオンライン配信ライブをやったり、少し前ならすごく特殊なことが今や普通のことになっていますよね。だから僕たちは、その更に先を行かないと。

真鍋大度(まなべだいと)

1976年、東京都生まれ。大学卒業後、大手電気メーカーに就職するが1年で退社。2002年 IAMAS(岐阜県立国際情報科学芸術アカデミー)に進学しプログラミングを学び、2006年Rhizomatiksを設立。以後、さまざまなアーティストのMVやライブ演出、スポーツイベントやファッションショーの演出を手がける。現在も東京を拠点に、アーティスト、インタラクションデザイナー、プログラマ、DJとして活動。

関連記事を読む