全世界で25万社以上の法人顧客を抱え、世界1万7000人の社員数を誇る、フランス最大のソフトウェア会社『ダッソー・システムズ』。技術革新のみならず、積極的な M&A で成長してきたビジネス界では名の知れたビッグカンパニーだ。しかし、製造業をはじめとした B to B (企業間取引)、B to B to C(企業が個人消費者向けに商売するのを手伝うビジネス)向けのサービスが中心で、しかもソフトウェアという目に見えないものを提供しているために、一般にはあまり馴染みがない。

そこで、まずは同社の歴史やサービスの歴史を踏まえながら、これからのものづくりが進んでいく未来について、アカデミアプログラムディレクターのフィリップ・コカトリックスさんに話を訊いた。

地球上の9割の航空機は

ダッソー・システムズの設立は1981年。もともとは、フランスの戦闘機『ミラージュ』や、ビジネスジェット機の『ダッソー・ファルコン』の製造で知られる、ダッソー・アビアシオン社の開発部門であった。

1960年代、設計といえば製図道具を使い手で線を引いていたが、メインフレーム(汎用大型コンピューター)の登場により、コンピューターで設計をおこなう動きが加速。ダッソー・アビアシオン社も1970年代後半より、設計や風洞実験ができる独自のソフトウェアを開発することとなる。その後、自社ソフトを一般販売することになり、分社化して誕生したのが『ダッソー・システムズ』というわけだ。

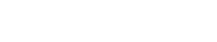

そんな経緯もあり、ダッソー・システムズ = CADソフトの会社として認知している人は多い。もちろん、現在も3D CAD設計ソフト『CATIA(キャティア)』は主力製品であり、特に航空産業では広く使用されている。地球上で飛んでいる9割の航空機はこのソフトを使って設計されていると言われるほどだ。

1989年、設計されたパーツを 「当初は、CADソフトを使って各種パーツを設計すること自体が革新的でした。その後、それらのパーツをデジタル空間の中で組み立ててモックアップ(試作品)まで制作できる、“3D DMU“という手法を1989年に打ち出します。ボーイング777は、ダッソー・システムズのDMUを全面的に使用して設計された最初の商用航空機でした。」

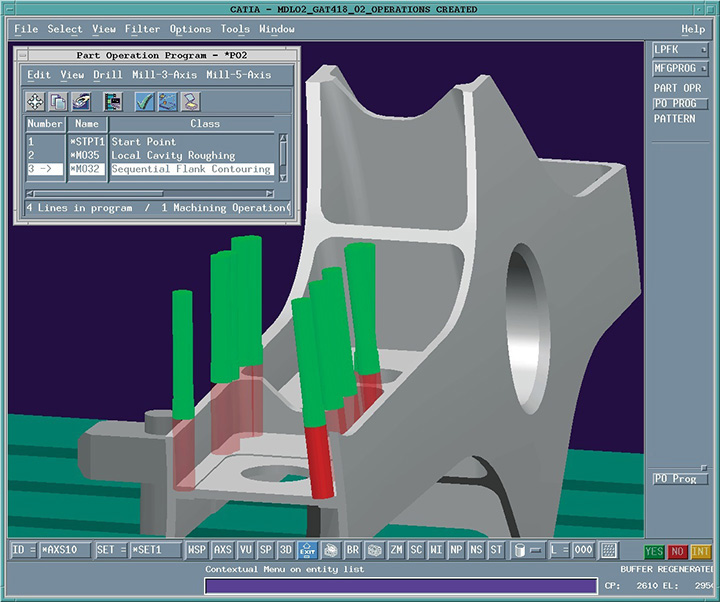

一般的に、製品を販売するまでには各種の検証が必要である。そのためには、フィジカル(物理的)な試作品を作るのがセオリー。しかし商用航空機のような試作品を制作するには、膨大なお金と時間を要する。しかも、仕様変更があれば、新たに試作品を作りなおさなければならない。しかし、デジタルモックアップであれば、設計変更や検証をデジタル上のデータモデルを使って行えるため、お金も時間も大幅に削減可能だ。

CATIA Version 4では、製品の完全なデジタルモックアップ(DMU)を実現し、仮想空間での製品の検証や確認が可能に。

他部署との連携を可能にした3D PLM 「10年後の1999年には、3D PLM(プロダクト・ライフサイクル・マネジメント)を打ち出しました。これは、設計から所有まで、製品のライフサイクル全体を管理できるシステムです。各種実験やシミュレーションをデジタル上でおこなうのみならず、製造から販売後のメンテナンス、廃棄処理の方法までもデジタルデータを連携させながら管理できるようになりました。それまで、企業の各部門(設計、解析、製造など)は、それぞれ専門性が高いゆえにサイロ化(他部署と連携できずに孤立化)してしまう問題がありましたが、PLM によって各工程をシームレスにつなげて連携することができるようになりました」

従来、各部署の設計や解析といったデータはそれぞれのソフトでおこない、仕様書のようなファイルの受け渡しと変換が必須だった。しかし、お互いの分野が専門的すぎるがゆえに、各部署の連携がうまく行かず、ファイルの散逸やファイル変換に伴うミスがおこるという欠点も。PLM はこうしたサイロ化を回避しミスを削減できるという画期的なものであった。

現在はVR でクルマのドアの開閉音も確認可能 「2012年にはさらに進んだ、3DEXPERIENCE プラットフォームを発表しました。こちらも主な目的は、連携時のサイロをなくすというものです。さらに、製造部門のみならず、マーケティングやセールス、パートナー会社、さらにはユーザーまでもが同時にコラボレーションできるようになりました」

VIDEO ダッソー・システムズが提唱する産業の未来、インダストリー・ルネサンス。「映像内の富士山とチューリップ以外は、ほぼダッソー・システムズのソフトウェアで作られたもの」とは広報担当者の弁。

EXPERIENCE(エクスペリエンス)とは経験や体験という意味。クラウド化されたプラットフォームの中心には、プロジェクトが目指すべき「エクスペリエンス」があり、それは3Dのデジタルツインで表現される。

「VR を使えば、クルマの運転席からの視界や、ドアの開閉音までも確認できます。また、高速道路を走っているときのエアコンの音と、田舎道でのエアコンの音の違いも確認できます。これまで、音に関しては何デシベルといった数値で表現されていましたが、マーケティングやセールスの人間は数値を見てもよくわかりません。逆に、ユーザーが納得する音のレベルがどの程度なのかは、技術の人間だけでは判断に迷うこともある。誰もが参加できるプラットフォームを設け、極めてリアルに近い3Dデジタル・モックアップを使いながら、音や質感などの細部も含めて経験する。そうすることで、部署を超えて問題点を議論することができます。ユーザーの体験は、音や質感、機能など、すべてを含む総合的なものですから」

プラットフォーム化およびデジタルツインの革新性は、部署を超えて対等&スピーディに話し合える点にある。しかも、物理的な試作品を作る前にあらゆる問題点を確認できるので、お金もかからない。もちろん、仕様変更もパソコン上でできるので簡単だ。製品の発売後も、ユーザーがネットに書き込んだ問題点などを即座に検討して対応することもできるなど、これからの製造業に必要な機能が詰まっているのだ。

後編へつづく