脳科学とAIの融合分野において世界をリードする金井良太氏。金井氏が代表を務める株式会社アラヤでは、人間の脳の仕組みをAI技術に応用し、製造業を中心とした企業に最先端のAIソリューションを提供している。同社が得意とするエッジAIとは何か。そして、金井氏がプロジェクトマネージャーとして参加する内閣府のムーンショット事業の狙いとは。次世代AIの可能性について、HERO X 編集長・杉原行里が聞く!

クラウド不要のエッジAIとは

杉原:御社の強みであるエッジAIとは、なんでしょうか?

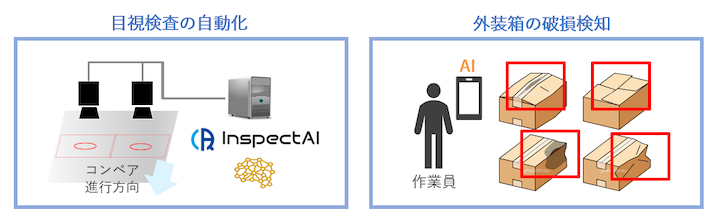

金井:エッジというのは、スマホやカメラのような端末のことです。一般的なAIは映像をクラウドにあげて、クラウド上で計算して答えを返しますが、エッジAIはスマホなどのデバイス上で計算するというものです。全部クラウド上で自動にすると、遅延も生じてしまうし、計算が重たいですよね。それを、ディープラーニングまで含めてデバイス上で実行するのがエッジAIという技術です。

杉原:クラウドにいったん上げなくていいということですね。

金井:まさにそうです。そのほうが安価だったりします。

杉原:なぜほかのシステムはクラウドに1回上げるということになっているのでしょうか? アイデアがないのか、気づいていないのか。

金井:みんなエッジでやりたいはずですが、なぜできないかというと計算が多いからです。そこで、計算を少なくするとか、計算をしやすいようにするとかの手法が、我々の技術ドメインになると思います。

杉原:変数が少なくなるという感じでしょうか?

金井:そうですね。入力のビット数を減らしたり、あとは枝刈りといって、計算する時にニューラルネット(人間の脳の働きを模倣する数理モデル)のつながりを減らしても同じような計算結果が出るようにするなどです。

杉原:そう伺うと単純な疑問が出てくるのですが、クラウドに上げて計算したものと、御社のエッジAIで計算したものとでは、この言葉が正しいかどうかわからないのですが、整合性は保てるのでしょうか?

金井:いえ、計算を簡単にしてしまうので、性能は落ちます。ただ性能を落とさずに計算を減らすというようなことを研究開発しています。自動運転などではかなり高い精度が求められますので、実際に我々が手掛けているものは工業製品の検査とかが多いですね。

今のAI開発は野球でいうと

ピッチャー量産型!?

杉原:御社のサイトに掲載されている「お掃除ロボットの例」(https://www.araya.org/about/feature/)ですが、要は機械による自動化は地図に沿って走行計画を作っていくけれど、自律AIなら「部屋をきれいにする」という目的を人間と共有する、という。この言い方が僕はすごくわかりやすかったです。

金井:今のAIの使われ方は、物事を自動化するところがメインで、その先に自律というアイデアがあります。自動というのは人がやり方を教えてその一部をAIに置き換える手法ですが、自律の場合は、目的を与えたらやり方を見つけ出すところまで、AIがやる。さっきのお掃除ロボットだったら部屋をきれいにするためには途中の問題も自分で解く必要がありますが、現状のディープラーニングは自動レベルのものが多いです。我々はそこに強化学習や深層強化学習と呼ばれる手法を取り入れていて、それを使うと自律への道が開けるのではないかと考えています。

杉原:面白いですね。御社はAIに意識を実装する研究もしているとお聞きしましたが、すごくシンプルな質問をしていいでしょうか? 意識ってなんですか?

金井:意識は感覚だと思いますね。ものを見た時は「見た」という感覚が生じるし、痛みを感じたときは「痛い」という感覚が生じる。そういう主観的な感覚のことを意識と言っています。

杉原:五感で感じられることが意識ということでしょうか?

金井:そう、感じる能力ですね。それをAIにもたせようと思ったら、結構具体的なことを考えなきゃいけない。自発性とか、想像力とか、AIが考えるというのはどういうことか、みたいなことを突き詰める必要があります。でも、そういうことを考えていくと、普通のAIとは違う作り方を思いつける。だから、新しいAIのアーキテクチャを考える時のヒントとして、意識をもたせるには?ということを研究したりはしますね。

杉原:この意識をもったAIが、どのような分野に入ってくるんでしょう?

金井:今、仮説としているのは、いわゆる汎用人工知能みたいなものが作られるということです。脳の中にはたくさんのAIが一緒にいる状態で、その合体方法を意識というプラットフォームが示している。今のAIは機能特化型といって、姿勢の推定や、表情の読み取りなど、1つのことに特化しています。だけど人間はそれをうまく組み合わせて考えることができる。だから、今いろいろな人が作っているAIを統合して、ひとつの強力なAIを作る方向になるのではないかと思います。

杉原:野球でいうと、今のAIはピッチャーばかり作っているみたいな感じですよね。でも、金井さんは「野球やろうぜ」と言っている。

金井:そんな感じですね。チームをちゃんと作ろう、という意味です。

ムーンショットで

BMIの技術開発

杉原:御社を知るきっかけになったのが、内閣府が進めているムーンショット型研究開発制度です。目標1のブロックで民間企業として参加しているのは御社だけですが、参加のきっかけはなんでしょうか?

金井:ムーンショットの目標は、「時間と空間と脳と身体の制約から解放される」という突拍子もないものです。これは自分に向いていそうだなと思って、普通に応募しました。

杉原:今回ムーンショット1で、2050年までに御社が達成したい目標はありますか?

金井:まず2030年までにBMI(ブレインマシーンインターフェース)を実用化できるレベルをめざしています。BMIには侵襲・非侵襲といろいろあります。最初、イーロン・マスクがやっているみたいに侵襲で脳に電極を埋め込むことを考えていたのですが、それ以外にも非侵襲で普通に脳波をとったり、あとは意外と外から画像だけ解析すればいけるんじゃないかと思って。脳を見なくても何をやろうとしているかが予測できればよいので、AIのノウハウを最大限応用すれば、侵襲性が低くても人が何か考えただけでモノを動かすくらいのことができるのではないかと思っています。

杉原:PoC(プルーフオブコンセプト)としてどのあたりに入りそうですか? エンタメでしょうか? それとも老人や言語が伝えにくくなった方たちに、最初に実証していくのか。

金井:侵襲と非侵襲で使える場所が違うと思います。侵襲のほうは完全に四肢麻痺やALSのかたの身体の補完という医療用の目的。非侵襲のほうは意外に自分自身のモニタリングみたいなものに使われるんじゃないでしょうか。まず自分の疲れを知るとか、鬱や過労を防止するみたいに使って、そのあとにインターフェースとして検討されていくと思います。たぶん、声を出さないでしゃべるくらいにはなると思います。

杉原:すごいですね。例えば触覚センサーみたいなものをつけて、より重さや触覚が伝わっていくと、自宅でロボットを遠隔操作することもできますよね。

金井:そうですね。入力のところを簡単にすればいいのかなと思っています。BMIですごくいいものを作ろうとすると、精密なデータが脳からとれて、ロボットのほうも自由度が高いイメージになりますが、そこまでいかなくても「前に進みたい」と思ったら、歩くところはもう全部半自動でロボティクスでやってしまえばいいのかなと。

事業者のほうが脳の研究は進んでいる

杉原:HERO Xはスタートアップのかたも読んでいるので、起業の時に大事にしていたことをお聞きしたいと思います。

金井:起業をする時は、少しでも前に進みたいと思っていましたね。進まないのが一番つまらないので。あとから考えるといろいろ失敗もありましたが。

杉原:研究領域だけではなく、実装領域も兼ね備えるための起業だったのでしょうか?

金井:そうですね。研究でできることは限られているんです。特に脳の画像を見て、個人の特徴、例えば知性とか性格とかを読み取ることはかなりできていたので、そういうことを役立てたいと思っていました。脳の研究も、Googleのような企業が圧倒的になってしまって、アカデミックな研究よりも自分が事業を作ったほうが研究が進むのではないかと思ったんです。起業したい人からよく相談を受けるのですが、実際にはなかなか起業しないですね。やってみればいいんじゃないかと思うのですが。

杉原:僕もよくそういう相談を受けますが、悩んでいる方が心に悪いですよね。

金井:やったほうがいろいろ得られるとは思いますよね。

杉原:最後に、今後AIはどんな風に生活に入り込んでいくと思いますか?

金井:着実に様々なところに使われ始めるとは思います。ただスマホやネットレベルの、誰も気づかないけれど、実は広範囲に使われていたみたいな存在になっていくのではないかと。

杉原:人々がそれを実感して気づくタイミングって15年、20年くらい先ですか? それとも、何気なく生活がアップデートされていって、そもそも気づかない?

金井:後者だと思いますね。パソコンが速くなっても気づかないみたいなことだと思います。

杉原:気づいたら20年前よりかなりよくなっているよね、みたいな感じですね。金井さんのAIに対するアプローチってすごく新鮮というか、ほかのかたからあまり聞いたことないなと思います。会社の事業としてはBtoBが多いのでしょうか?

金井:ほぼBtoBのAI開発と、R&Dのお手伝いですね。自動車の会社が多いです。

杉原:ぜひレース業界もよろしくお願いします。マシンも、いまや走るセンサーといわれていますから。今日はどうもありがとうございました。

金井良太(かない・りょうた)

株式会社アラヤ創業者。2000年京都大学理学部卒業後、2005年 オランダ・ユトレヒト大学で人間の視覚情報処理メカニズムの研究でPhD取得(Cum Laude)。米国カルフォルニア工科大学、英国ユニバーシティ・カレッジ・ロンドンにて研究員。JSTさきがけ研究員、英国サセックス大学准教授(認知神経科学)を経て、2013年に株式会社アラヤを創業。神経科学と情報理論の融合により、脳に意識が生まれる原理やAIに意識を実装する研究に従事すると同時に、産業界におけるAIと脳科学の実用化に取り組む。文部科学大臣表彰若手科学者賞、株式会社アラヤとしてJEITA ベンチャー賞(2020)、ET/IoT Technology Award(2019)など多数受賞。2020年より、内閣府ムーンショット事業プロジェクトマネージャーとしてブレイン・マシン・インターフェースの実用化に取り組む。

関連記事を読む