従来のスポーツ観戦スタイルといえば、映像、あるいは会場での生観戦。手法は違えど、試合を俯瞰するという行為によりその“視点”は共通している。そこに新たなスタイルと注目されるのがVRを使った観戦だが、独立行政法人国立高等専門学校機構東京工業高等専門学校(以下:東京高専)のチームが開発した『シンクロアスリート』は、VR(ヴァーチャル・リアリティ)やモーションベースといったテクノロジーを活用し、アスリート目線の臨場感あふれる体験を提供する。選手たちを俯瞰するのではなく、選手と同化する。新たなスポーツ観戦システムを作り出した彼らに、開発の経緯について聞いた。

アスリートの世界へ没入。

仕組みは学生オリジナル

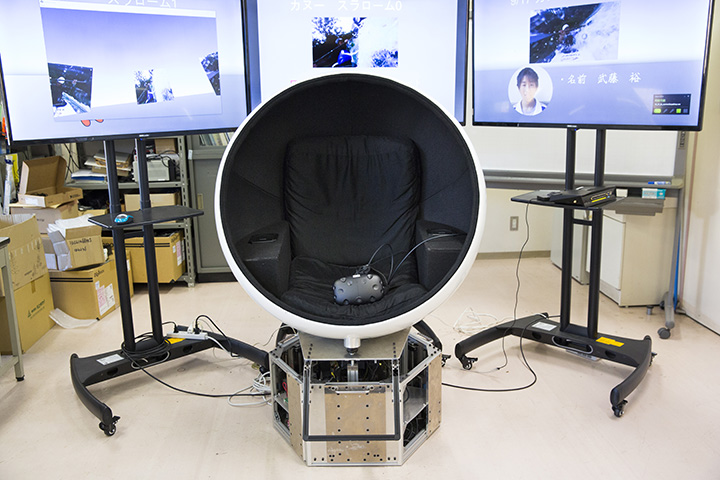

専用のゴーグルを装着し、座席に腰掛けると、たちまちアスリートの視点へとダイブする。

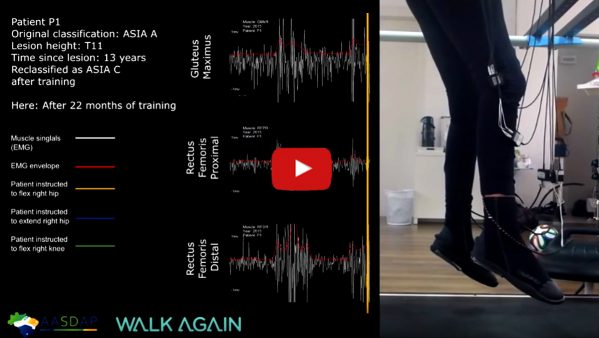

「氷上の格闘技」とも呼ばれるスピードスケート・ショートトラックや、激流を乗りこなすカヌー・スラローム、さらに、トラックを疾走するレーサー(陸上競技用車いす)。さまざまなアスリートの目線と動きに合わせて、ディスプレイに映る景色がリアルな音声とともに流れ、座席自体も上下左右に可動する。「リプレイモード」と「リアルタイムモード」という2つの機能を搭載しており、前者は、予め収録した競技映像と動きを用いて、ユーザーが実際に競技をしているような体験をすることができる機能だ。収録には、360度カメラと、加速度センサーを内蔵したスマートフォンを使用する。後者は、前者における2つのツールに加えて、ライブ配信用の小型サーバを選手に身につけてもらい、今まさに競技をしている選手の目線と動きを、ユーザーがリアルタイムに体感することができる機能。アスリートと同化した臨場感溢れる体験は、もはや“競技観戦”の領域を越えていると言えよう。

その体験は、選手目線の映像を再現するヘッドマウント・ディスプレイ(HMD)と、選手の動きを再現するモーションベース(=通常、自動車や航空機、宇宙船の操縦試験、訓練に用いられる可動式の装置)によって生み出される。設計、部品加工、組み立て、プログラミングまで、すべて東京高専のオリジナルだ。

新たなスポーツ観戦システムは、『第7回ものづくり日本大賞』(※1)でも評価され、内閣総理大臣賞を受賞。今年10月に開催された『国際福祉機器展』でも展示され、東京2020でカヌー競技が開催される東京都江戸川区との協業も進行中だ。今回は、初期開発メンバーの1人で、ソフトウェア部分を担当した瀧島和則さん、松林勝志教授、山下晃弘准教授、現在のチームメンバーである米本毬乃さん、一瀬将治さんに話を伺った。

※1:『第7回ものづくり日本大賞』における「ものづくりの将来を担う高度な技術・技能」分野「青少年部門(大学・高等専門学校・専門学校クラス)」にて受賞。

開発のきっかけは学園祭の「ジェットコースター」

『シンクロアスリート』開発の経緯を語る瀧島和則さん

「シンクロアスリート」開発の経緯について教えてください。

瀧島:発端は、3年前(2015年)に、当時のクラスメートの1人が「ジェットコースターをつくりたい」と言い出したことでした。けれども、実際にジェットコースターのコースをつくって教室で走らせるのは危ないと。そこで、モーションベースを用いて、「ヴァーチャル・ジェットコースター」という形で擬似再現できるのではないかと思い、学内の文化祭に向けて開発をして、当時は装置の動きも遅かったのですが、なんとか完成させることができました。

松林:その時は、布でスクリーンをつくって、3台のプロジェクターを使ってジェットコースターに乗車時の映像を投影しました。映像は全部CG。計算作業に1ヶ月ぐらいかかりましたね。

瀧島:学園祭で展示したところ、乗った人みんな、キャーキャー言っていて、「凄くよくできたね」と大好評でした。すると、その翌年の高専プロコン(=全国高等専門学校プログラミングコンテスト/※2)の課題部門が、東京2020が近いこともあり「スポーツ」がテーマだったんです。そこで、ヴァーチャル・ジェットコースターの仕組みをスポーツに応用してみてはどうかということになりました。カメラでスポーツの映像を撮影し、センサーを用いて選手の動きを収録して、モーションベースで再現すれば、スポーツにおける実際の動きと映像を体感してもらうことができるのではないかと。なんとかコンテストに間に合わせて、結果的に最優秀賞を頂くことができました(※3)。

※2「ロボコン」で知られる『全国高等専門学校ロボットコンテスト』初開催の翌年(1989年)から開催されている高専生によるプログラミング大会。

※3:文部科学大臣賞、最優秀賞、情報処理学会若手奨励賞を受賞した。

東京2020の開催自治体もバックアップ

開発で工夫された点はどんなところですか

瀧島:モーションベースという装置は通常、自動車の運転や、航空機の操縦シミュレーションに用いるため、正確な動作が求められますが、私たちは、精度はある程度担保した上で、人が乗って選手の動きを楽しめる装置を目指して作りました。映像については、今までは選手目線のスポーツ観戦が難しかったので、実現できれば、技術的にも観戦のスタイルとしても面白いのではないかと考えていました。

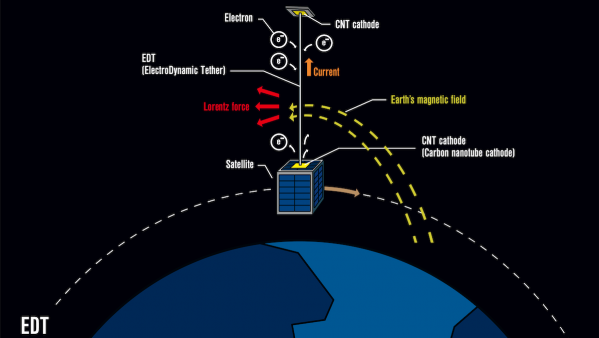

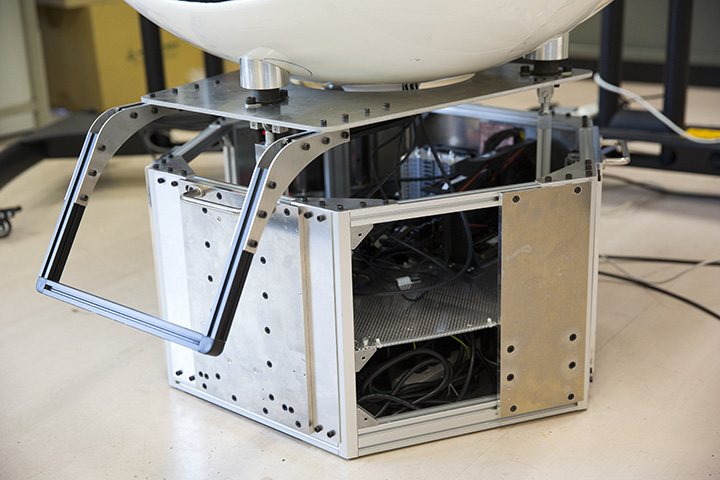

松林:さらに工夫したポイントは、装置の小型化です。モーションベースは、大きな物になると油圧システムを使います。そうなると金額も大変高価ですし、体積も重量も大がかりになってしまうので、スポーツ会場やその付近まで運搬することが困難になると考えました。ですので、『シンクロアスリート』のモーションベースは電動式を採用して、小型化に成功しています。通常のモーションベースと異なる点は、水平回転ができないことですが、それはHMDに360度映像を映すことで補完することができました。

例えばカヌーなどは、動きもダイナミックなので相性が良さそうですよね。

松林:はい。3軸のシステムで水平を保ったままの上下運動が可能なので、それを活かしたスポーツが良いだろうと,考えました。アイディアとして浮かんできたのがカヌー競技です。上下運動で船の動きをリアルに再現することができます。そこで、東京2020でカヌー競技の会場となる江戸川区にお願いをして、江戸川区カヌー協会さんを紹介して頂きました。江戸川区としても競技施設はできるけれど、区としてどのように区民の方々の理解を促す広報活動を展開していこうか、ということも課題だったようです。そこに『シンクロアスリート』のお話をして、全面協力して頂けることになりました。

「着席位置の違い」までわかる精巧さ

東京2020の開催も追い風になっているのですね。逆に、開発で苦労した点はありますか。

瀧島:(昨年卒業した)機械工学科の学生が作ったハード部分と、私たち情報工学科の学生で担当したソフトウェアのすり合わせが大変でした。

具体的にどんなすり合わせをするのでしょうか。

瀧島:「機械本体」と機械を制御する「モータードライバ」とモーターに指示を送る「コンピュータ」と3つの系統があって、各部分で通信・電力のやりとりをする必要があります。コンピュータの指示が誤って伝達されると、ドライバが故障してしまったり、正常に動作しなかったりするんですが、実際に組み立てて試験運転してみるまでわからない。だから、通信の不具合チェックが開発の最終段階になってしまい、そこからの修正が大変でした。

ユーザーが着席するシート下部にあるモーションベース

ライブ配信の開発にも結構苦労しました。スポーツ会場での生中継ならば、電波の伝達速度の都合上、実際の競技と映像や動きに多少のタイムラグが生じるのは許容範囲です。しかし、展示会等でライブパフォーマンス的に見せる場合は、5秒、10秒遅れたら話になりません。その遅延時間をいかに減らすかはかなり苦労しましたね。現在はWi-Fi回線を使用して動かしていますが、遅れはほぼ感じない状態に持っていくことができています。

今年開催された江戸川区の展示会(『第20回産業ときめきフェア in EDOGAWA』)や『国際福祉機器展』でも展示されていましたが、体験した方の声はいかがでしたか。

米本:小さいお子さんから高齢者の方まで幅広い層の方に乗って頂きましたが、アンケートをとってみると、「楽しかった」という声も多く頂き、狙いどおりでした。シンクロアスリートによって、ひと味違ったスポーツ体験を楽しむことができるという実感を得ることができました。

松林:カヌーのクラブハウスで関係者にも乗ってもらうと「非常にリアルでよくできている」という意見を頂きましたが、一方で「普段座っている位置よりも前方に座っている感じがする」と。なぜならば、カメラの位置が実際のカヌーのシートよりも少し前についているからなんです。つまり経験者にとっては、通常との場所の違いまでわかるほどリアルに仕上がっているということです。実際にシンクロアスリートの動作と、本物のカヌーの動作を波形比較してみたところ、ほぼ一致していました。安全面を考慮して、激しい動きはカットしていますが、ほぼ完璧に再現できています。波形が一致するように、機構学を用いて計算を行ったので、一致するのは当然といえば当然なのですが、実際に一致していると嬉しいですよね。

(後編へつづく)