人と人とのコミュニケーションに必要なものは、言語だけにあらず。視線やジェスチャー、表情といった非言語情報も不可欠であることはいうまでもない。岡田将吾氏は、それを社会的信号処理という新しい領域に基づいた研究を通して読み取ることを実践する先駆者のひとり。同氏の試みは、人間の内面の状態を理解するためのAIの新分野として世界から注目を浴びる。これらの研究は認知症の初期症状などを読み取る手がかりにもなるという。編集長・杉原が、最先端の研究の現状とその先に広がる未来について伺った。

人の行動から内面状態を理解するという試み

杉原:もともと岡田さんは、大学でいわゆるAIに関する研究をされていたんですか?

岡田:そうですね。人工知能を基本に、修士、学士と約5年間研究をしまして、少しずつ人の行動を予測するとか、人の行動からコンテキストを推定するということにフォーカスするようになりました。 例えば、この人のしゃべり方や使う言葉の特徴がこうなら、この人はロボットとのおしゃべりを楽しんでいるとか、いくつかの行動から、人の内面を予測するというような研究です。

杉原:今日は、話していて僕の思惑がバレるかもしれないから、サングラスか何か掛けたい気分です(笑)。

岡田:いや、僕自身は(内面を予測することは)できないですよ(笑)。システムにはできてしまうことがありますけどね。

人の行動から内面を読み取るという研究を続ける岡田氏。「最近は、手の動きと感情の関係性が気になる」という。

杉原:ならよかったです(笑)。岡田さんのそういった研究は、AIなどを通じて出口がたくさん出てきたという段階ですか?

岡田:そうですね。最近は動作を測るセンサーが安くなったりもして、状況が変わってきましたし、企業でも自分たちのような研究をしているところが出てきました。そういうプロジェクトに自分が加わることも増えてきて、出口は広がったと感じています。

杉原:もともと岡田さんがAIに興味を持ったのは、どういった経緯でしょうか?

岡田:最初は大学で物理をやっていたのですが、物理の世界っていろいろと難しくて挫折してしまいました。それで物理の先生にはちょっと失礼なんですが(笑)、もう少し目に見えてわかりやすいことがやりたいと思って、ロボットに顔の認識や画像の認識をさせて動かすという研究をやっている研究室に入ったんです。AIを研究し始めたのは、そこからですね。

杉原:岡田さんのような分野の研究者は、日本にどのくらいいらっしゃるんですか?

岡田:もちろん産官学で人工知能の研究をされているグループは山ほどありますけど、ピンポイントで、人の行動から内面状態を理解するみたいなことに焦点を当てているのは、僕たちと数えるくらいしかないです。

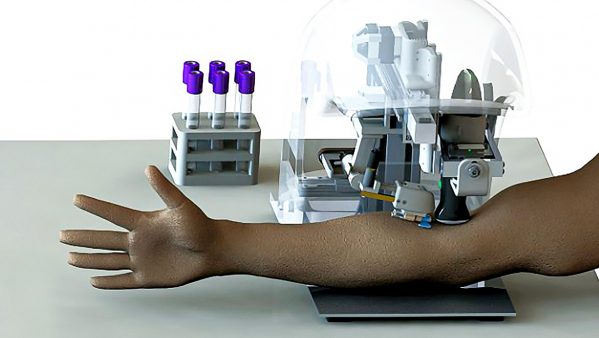

こちらは、2018年にジョージ・アンド・ショーン合同会社(現株式会社)と岡田研究室が共同で開設したG&S Labのイメージビジュアル。IoTデバイスであるbiblle(ビブル)を活用して、行動学習に特化した機械学習プログラムの開発を行っている。

もう多くの企業ではAIが採用面接をしている!?

杉原:表情から何かを読み取るということは、なんとなく僕もイメージできるんですが、そこから購買意欲だったり、そこに出口を見つけていくというのは、なんだか大学でやる研究っぽくないなと思いますね(笑)。

岡田:そう言われれば、そうかもしれないですね。

杉原:僕自身のイメージでは、大学の先生は研究を突き詰めて、あとはアウトプットを第三者に見つけてもらう、そんなスタイルが多いなと常々感じているんですよ。それが出口までしっかりとしていて、岡田さんの研究は面白いなと思います。

岡田:そう言っていただけるとありがたいです(笑)。確かにそれは狙っていて、研究室でコンピューターの前に座って突き詰めるのではなく、実際のインパクトのあるデータに対して、なんらかの回答を出していくほうが、世の中的にも出口がわかりやすいですし、そういうことは意識していますね。

岡田氏の研究に興味津々の杉原。感情という抽象的なものを数値化するという試みには、シンパシーを感じているようだ。

杉原:世界的にはどうなんですか?

岡田:コンピューティング分野の国際会議のような場には、アメリカ、ヨーロッパの有名大学の研究者が集まってきますが、そこでは感情を理解するという研究が一番多いように感じます。コンピューターにいろいろな感情を理解させるということが基本ですけど、話している声や内容、表情からコミュニケーションのスキルを推定するということも盛んになってきてはいます。AIによる企業の採用面接みたいなものもそうですね。

杉原:確かにそういう面接は、実際にあるようですね。

岡田:面接で一言、二言答えたことから推測して、その人(のスキル)を判定するということですよね。あらゆる企業は、もうAIを様々活用しているのですが、採用には特定の人しか受からないとか、雇用差別・公平性の問題が出てきたりもしています。自分も就職面接のように実際に多くの人を呼んで、はじめて会った学生同士でディスカッションをしてもらい、そのビデオを人材派遣の会社に送って、人事の採用担当者に点数をつけてもらうという試みをしたことがあります。同じようにAIにも判断してもらったら、熟練の採用担当者と同じように人を選ぶのかどうかを検証しました。その実験は、学会でも良い評価をもらいましたが、アプリケーションとして見た場合、考慮すべき課題が多いと感じます。ですので、そういうスキル判定の技術を使って、スキルを上達させるための訓練に活かすことを、これからはやっていきたいですね。困っている人が喜ぶようなアプリとして機能できればと思っています。

感情を数値化するには、大きな課題がいくつもある

杉原:なるほど、それは興味深いですね。もうひとつお聞きしたいのが、“感情”っていうのは数値化も可視化もしにくいのではないか、ということです。実際に研究は進んでいるんでしょうか?

岡田:そうですね、難しいところも確かにあります。いま主にやっていることは、心理学者たちがこれまでに作った評価指標に則って、実験後に、いまあなたの感情はいくつでしたか? というように被験者に問いかけたり、第三者に被験者の映像を見せて、被験者の感情状態はどうなっていると考えられますか? というようにアンケートを書いてもったりする手法なんです。それをもとに人工知能が答えを導き出すわけですから、そもそものアンケートの答えが間違っていると、人工知能的にはもう破綻してしまう。そこが弱点でもありますね。

杉原:まず、ちゃんとしたデータを取ることが難しいんですね。

岡田:正解のデータがしっかりと作れなければ、人工知能は動けませんから。正直、感情って自分で数値をつけるのは難しいですよね。

杉原:自分でも自分の感情が一番わからないこともありますよね(笑)。

岡田:そういうものなんですよ(笑)。

杉原:以前の心理学者の研究だったり、研究論文なんかを追っかけながら、感情を紐解く要素を分析していくという手法はもちろんわかりますが、IoTを使ったデータ集めというのは、どうなんでしょう。世界的にはビッグデータは集まってきているんですか?

岡田:それも難しいところではあるんです。GAFAは、画像・音声を含めWeb上でたくさんの情報を集めていますが、普段の人同士の会話や、自然に対面コミュニケーションしているときのデータを膨大に集めるのは、まだまだ実際には難しいですよね。例えば感情データを集めるために、誰かが怒っているところをずっとビデオで撮るわけにもいかないですし、これからデータを取るので怒ってください、っていうのもおかしいですしね(笑)。多くの人が、AI speakerと友達のように頻繁に話す未来が来たら変わるかもしれませんが、AIの対話機能レベルから言って、それはもう少し先になりそうです。

杉原:確かにそうですね。

岡田:だから、自然にそういうデータをどうやったら取れるのか? っていうのは自分たちの研究の大きな課題ですね。

杉原:ライフログ的なところですね。とはいえ、無理やりIoT的な要素をくっつけたものを開発して使ってもらっても、結局使わなくなりますしね。

岡田:そうですよね、スマートウォッチとかもその一例だと思います。

杉原: スマートウォッチが出た当初はすぐに買いましたけど、3日後にはこれまで使っていた普通の時計が恋しくなってしまいました(笑)。でもいまは、Apple Watchなどがセンシングに使われていますよね。睡眠だったり、バイタルだったり。そういう使われ方をしているのは有意義だと思います。

岡田:そうですね、そのような使い方は興味深いです。最近私たちもスマートウォッチのようなセンサを使った研究を始めています。とはいえ自分たちの研究は、いまはデータを採取するのにビデオの前に人を座らせなきゃならないので、常に記録するのが難しい状況です。なので、毎日何かを記録すれば、健康がチェックできるとか、そういう多くの人に受け入れやすいアプリなどを通して、効率よくデータを取る方法を模索して行こうと思っています。

岡田将吾(おかだ・しょうご)

国立大学法人北陸先端科学技術大学院大学(JAIST)准教授。2008年東京工業大学大学院知能システム科学専攻博士課程修了。京都大学特定助教、東京工業大学大学院助教、IDIAP research institute 滞在研究員等を経て、2017年より現職。「社会的信号処理に基づく人間の行動やコミュニケーションの理解」を主要テーマに、AIの新たな領域の研究に取り組む。専門は、マルチモーダルインタラクション、データマイニング、機械学習、パターン認識ほか。