「長年の末、私の義手は、空っぽの貝殻に再び生命が吹き込まれたかのように感じます」――こう語るのは、2018年6月20日、米サイエンス・ロボティクス誌で発表されたエレクトロニックスキン「e-dermis」の試験者として、米メリーランド州Johns Hopkins University生体医工学科の開発チームに貢献したひとり。e-dermisは、義手の指先に取り付ければ、痛みや触覚などのリアルな感覚を再現できるという画期的な発明。だが、あえてなぜ“痛み”を感じる必要があるのか?

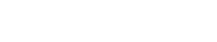

エレクトロニックスキン「e-dermis」は、人間の神経システムのレセプターを真似たセンサーを埋め込んだ布地とラバーの2層で形成されている。このセンサーが刺激を感知し、義手を取り付けた腕の切断端を通じて、末梢神経に伝達することによって、触感や痛みまでも再現できる。例えば、触れたものが丸ければ掴み、尖っていれば、反射的に手放す。

従来、義手を含む義肢単体では、触覚はもちろん、痛みの感覚を伝達することはできない。ゆえに、知らず知らずのうちに、義手にダメージを受ける可能性もあるが、e-dermisを付けた義手なら、ダメージを受ける前に、痛みのサインによって、怪我などからも自分を守ることができる。つまり、ここでいう痛みは、これまでの義肢に欠けていた保護のための触感だ。

「心地良い触感から不快な感触まで、より人間の手に近いさまざまな知覚を義肢によって感じられるのは、初めてのことです」と話すのは、Johns Hopkins University生体医工学科教授であり、米サイエンス・ロボティクス誌で発表したe-dermisの論文のメイン著者Nitish Thakor氏。

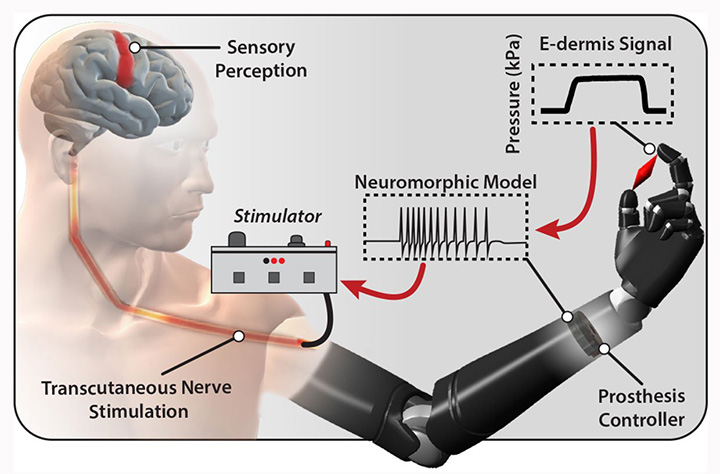

ただし、今回の研究は、触感と形、痛みの知覚や鋭さの検出に集中したものであり、e-dermisは、温度に敏感ではないと報告されている。開発チームは、今後この技術をさらに進化させ、より多くの人に普及するためのシステム構築を検討している。宇宙飛行士の手袋や宇宙服への適用やロボット分野での採用など、大いに可能性を秘めたエレクトロニックスキン。今後の動向に注目したい。

[TOP動画引用元:https://www.youtube.com/watch?v=AJe3wC6tiJM]